Varnostne prakse vodilnih UI podjetij močno zaostajajo za svetovnimi standardi

Glede na zadnje poročilo organizacije Future of Life Institute varnostne prakse največjih UI podjetij – med njimi Anthropic, OpenAI, xAI in Meta – močno zaostajajo za globalnimi standardi. Neodvisna skupina strokovnjakov je ugotovila, da se podjetja sicer pospešeno premikajo v smer sistemov superinteligence, a pri tem nimajo celovitih strategij za nadzor takšnih sistemov.

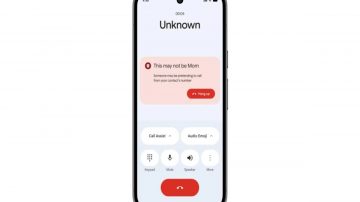

Poročilo je bilo objavljeno v času vse večje zaskrbljenosti javnosti glede vpliva umetne inteligence na družbo. Več incidentov, v katerih so UI klepetalniki povezani s primeri samomorov in samopoškodovalnega vedenja, je sprožilo razpravo o odgovornosti podjetij. Profesor Max Tegmark z MIT (Massachusetts Institute of Technology), ki je tudi predsednik Future of Life Institute, je dejal: “Kljub nekaterim zadnjim primerom, kjer naj bi umetna inteligenca odigrala vlogo pri tragičnih zgodbah posameznikov, so ameriška UI podjetja še vedno manj regulirana kot restavracije in aktivno lobirajo proti obvezujočim varnostnim standardom.“

Pomanjkanje regulacije in hiter razvoj

Tekma v razvoju umetne inteligence se kljub opozorilom ne upočasnjuje. Velika tehnološka podjetja vlagajo stotine milijard dolarjev v gradnjo in širitev zmogljivosti strojnega učenja. Future of Life Institute, ustanovljen leta 2014 in sprva podprt s strani Elona Muska, je neprofitna organizacija, ki opozarja na tveganja, povezana z naprednimi sistemi umetne inteligence.

Že oktobra so znanstveniki Geoffrey Hinton, Yoshua Bengio in drugi pozvali k moratoriju na razvoj superinteligentne UI, dokler ne bo zagotovljeno, da javnost razume tveganja in da lahko znanost vzpostavi varne mehanizme nadzora.

Odzivi podjetij

Na poročilo so se podjetja odzvala z mešanimi reakcijami. xAI je na primer objavil avtomatiziran odgovor z besedami “Legacy media lies” (laži tradicionalnih medijev), medtem ko se Anthropic, OpenAI, Google DeepMind, Meta, Z.ai, DeepSeek in Alibaba Cloud na poročilo niso odzvali.

Poročilo Future of Life Institute je tako še en opomnik, da lahko tehnološki napredek brez ustrezne varnosti in nadzora predstavlja resno grožnjo. Čeprav podjetja tekmujejo v razvoju vse zmogljivejših modelov, ostaja ključno vprašanje, ali bo varnost umetne inteligence dosegla enako raven pozornosti kot inovacije, ki jih prinaša.

Prijavi napako v članku