Comment reconnaître le contenu de l'IA ?

Vous pouvez toujours croire vos yeux que ce que vous voyez est réellement réel. Chaque jour, de nouvelles photos créées par l'intelligence artificielle apparaissent sur Internet. Les générateurs de photos comme Midjourney, DALL-E 3, Bing Image Creator (utilisant également le modèle DALL-E) deviennent si performants qu'il est parfois vraiment impossible de dire s'il s'agit d'une vraie photo ou d'une IA. Et ils le font en quelques secondes seulement, alors qu'un vrai photographe ou artiste doit investir beaucoup plus de temps pour capturer une photo similaire. Il doit tenir compte de la lumière, de la perspective, du choix du bon capteur, de l’emplacement, de l’horloge et bien plus encore. Dans Midjourney, on entre simplement quelques commandes et en moins d'une minute le programme propose plusieurs photos différentes.

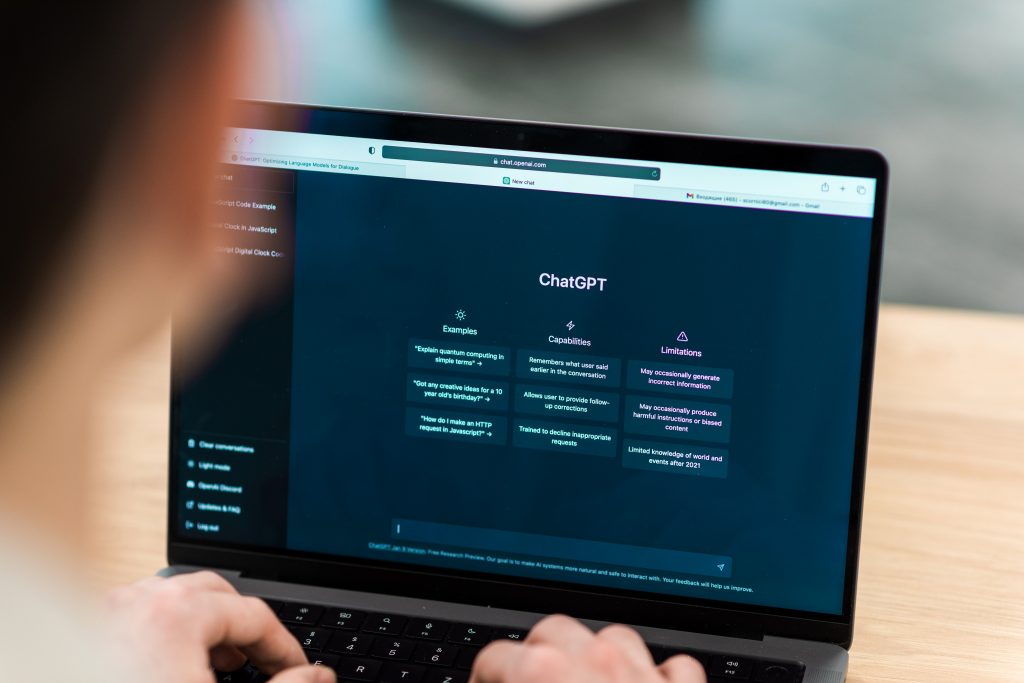

Récemment, un test a été réalisé aux États-Unis, au cours duquel 1 000 adultes ont été testés pour voir s'ils étaient capables d'identifier ce qui était réel et ce qui avait été créé par l'intelligence artificielle. Dans la moitié des cas, ils avaient tort. C'est la puissance du modèle de langage Sora, la dernière idée d'OpenAI, qui a déclenché cet engouement pour l'IA avec le chatbot ChatGPT.

Dans les années à venir, nous devrons tous devenir Sherlock Holmes et enquêter minutieusement sur tout contenu que nous jugeons douteux ou suspect. Même si le contenu est authentique, nous soupçonnerons au moins en partie qu’il ne s’agit pas d’un contenu d’IA – simplement en raison de l’existence de ces outils hautes performances.

Mais certains signes révèlent qu’il s’agit d’une intelligence artificielle. Des signes qu’il faut apprendre à reconnaître, même s’il est fort probable que ces conseils ne soient plus d’actualité dans quelques mois.

Trop d'orteils, orteils recourbés et autres anomalies

Les modèles linguistiques sont formés sur de grands ensembles de données, qu'il s'agisse d'images, de vidéos, de textes et de tout autre élément contenant des informations utiles. Ces connaissances leur permettent d'utiliser nos commandes pour composer de nouvelles images, vidéos et même enregistrements sonores. Vous avez peut-être remarqué qu’il existe de plus en plus d’enregistrements et de voix faux, ou deepfakes, imitant des célébrités à des fins frauduleuses. Par exemple : l'image d'Elon Musk a été récemment utilisée pour promouvoir des investissements douteux, tout comme le YouTuber MrBeast.

Pourtant, malgré tout, l’intelligence artificielle peut se tromper. Ses parties du corps lui donnent de gros maux de tête. Même les artistes expérimentés ont des problèmes avec les mains humaines, comment l’intelligence artificielle pourrait-elle ne pas en avoir ? Souvent, il ne sait pas quoi faire de ses mains ou de ses doigts, c'est pourquoi dans les images qu'il crée, nous voyons souvent une personne avec six doigts, trop peu de doigts, des bras trop longs, etc. Si le sujet tient un objet, il peut également arriver que le poignet soit retourné, ou que la main gauche soit posée sur le poignet droit, et méfait similaire.

Vous vous souvenez de la photo du pape François dans une veste très surdimensionnée ? Non seulement l'image entière ne correspond pas au statut du pape, mais si nous agrandissons l'image, nous pouvons voir que les doigts de sa main droite manquent ou ont fusionné en une masse étrange.

Si une photo ou une vidéo semble suspecte, vérifiez d'abord les membres. C’est là que l’intelligence artificielle fait le plus d’erreurs.

Faites attention aux détails

Même si le sujet principal peut paraître parfait, il peut se passer beaucoup de choses en arrière-plan. Si l’image est excessivement floue, mais que vous pouvez toujours voir en arrière-plan des objets dénués de sens ou déformés, c’est le signe que le contenu a été créé par l’intelligence artificielle. Cela s'applique aussi bien aux photos qu'aux vidéos. Même Sora, qui a dérouté la moitié des participants au test, a du mal à afficher systématiquement plusieurs sujets différents en arrière-plan, notamment des visages humains, dans les enregistrements.

La peau est-elle trop lisse ? Des cheveux trop parfaits ? Les caméras de nos téléphones peuvent faire beaucoup de choses, elles sont également efficaces pour corriger nos défauts de beauté, mais l'intelligence artificielle va encore plus loin. En fait, elle aime exagérer les correctifs de beauté, cela pourrait donc être l'un des signes qu'il s'agit de contenu IA.

La lumière, les ombres, les contrastes… peuvent aussi être un bon indicateur d’authenticité. Tout d’abord, vérifiez que tous les sujets ont leur propre ombre ou qu’elle pointe dans la bonne direction. Regardez les reflets et la façon dont la lumière rebondit sur différents objets. Chaque détail peut être le bon signe d’une photo (in)authentique.

La nourriture dans les publicités nous a toujours trompés. Même si en Slovénie nous n’avons pas encore assisté à une utilisation excessive de l’intelligence artificielle pour créer des publicités alimentaires, cela se produit déjà ailleurs. Vous la reconnaîtrez parce qu'elle sera encore plus parfaite que d'habitude, ou parce que le style de l'image vous rappellera trop les dessins animés.

Il n'est pas doué avec les mots

ChatGPT peut nous préparer un article, un poème, une histoire, une lettre d’amour ou toute autre chose en quelques secondes. Il fonctionne actuellement sur le modèle de langage GPT-4 (Turbo) et peut être un outil utile même pour des écrivains comme nous, mais sans instructions détaillées, nous nous retrouverons avec un contenu général qui n'est pas très intéressant. Il aime aussi beaucoup utiliser les mêmes compositions. Il aime utiliser « Dans ce monde numérique… » pour l'introduction, « Dans ce qui suit… » ou « Dans cet article, nous allons… » à la fin de l'introduction, les intertitres sont généralement très généraux. Par exemple, s'il décrit un téléphone, il utilisera le nom des composants pour les intertitres. Si l’intertitre est plus long, tous les mots seront souvent mis en majuscule. Il a des problèmes avec les prépositions, mais il aime aussi utiliser des mots qu'on n'entend pas très souvent, comme « concluant, rassurant… » et autres.

Il n’y a rien de mal à s’entraider avec les outils dont nous disposons. Il est cependant important d’utiliser correctement les outils, de vérifier le contenu et de le corriger.

Les mots sont un gros problème pour les générateurs de photos. Si vous lui ordonnez, vous voulez qu'il crée une carte d'anniversaire pour vous et qu'elle dit "Joyeux anniversaire, John ! Quand allez-vous adorer la ronde ? », vous aurez probablement la graisse. Le problème ne concerne pas uniquement les bruiteurs ; en slovène, les modèles linguistiques ont généralement des problèmes pour générer des mots dans des images. Même si vous souhaitez le texte en anglais, il peut arriver que vous obteniez quelque chose de complètement différent de ce que vous souhaitez.

Chaque générateur possède également son propre style distinctif de création de photos. Si vous utilisez DALL-E 3 régulièrement (au sein de ChatGPT), alors vous savez que sa marque est un style de photos plus animé. Une fois habitué, regarder une photo vous dira immédiatement qu’elle a été créée par l’intelligence artificielle.

Aidez-vous de Google Lens ou de la recherche d'images Google

Lorsque vous trouvez une photo suspecte en ligne, faites un clic droit dessus et "Rechercher avec Google", vous pouvez également la coller dans le moteur de recherche Google et Google vous montrera des résultats similaires. Vous remarquerez également « Rechercher une source de photo » en haut, qui fait exactement ce que vous pensez. Vous ne trouverez pas nécessairement le créateur original, mais au moins vous trouverez la preuve qu'il s'agit d'une vraie photo ou non.

Dans le monde réel, vous pouvez vous aider de la même manière avec Google Lens, caché dans chaque caméra des téléphones Android. Pointez votre appareil photo sur une photo, effectuez une recherche sur le Web et voyez les résultats. S'il y a une personne célèbre sur la photo et que Google ne vous montre aucun résultat pertinent, il y a de fortes chances qu'il s'agisse d'une photo IA.

Les yeux sur les tiges !

Le gros problème sera notre attention. Lorsque nous parcourons les réseaux sociaux, regardons de courtes vidéos YouTube, etc., nous ne prêtons généralement pas attention aux moindres détails et bagatelles. Il peut arriver à n'importe qui de remarquer une photo, un enregistrement ou un son et d'imprimer dans son subconscient qu'il s'agit de quelque chose d'authentique, même si ce n'est pas le cas.

Il existe des outils (IA ou non, Hive Moderation...) qui permettent de vérifier l'authenticité d'un contenu web, mais ils ne sont pas toujours fiables. Nous devrons nous fier à notre propre jugement et vérifier tout ce que nous voyons, lisons ou entendons.

Image de couverture : Image de frimufilms sur Freepik