Was ist AudioCraft, das neue KI-Tool unter Meta?

AudioCraft ist ein Open-Source-Programm, das aus Textansagen Effekte und Musik erstellt, ähnlich wie es KI-Bild- oder Videogeneratoren tun. AudioCraft bietet drei Modelle an:

- MusicGen zum Komponieren von Musik

- AudioGen zum Erstellen von Soundeffekten

- EnCodec hilft bei der Audiokomprimierung

MusicGen war zuvor unter Musikschaffenden und KI-Hobbyisten bekannt. Doch nun hat Meta den Code für dieses Modell enthüllt, der es Nutzern ermöglicht, es mit eigenen Musikdaten anzureichern. Verständlicherweise stellten sich sofort ethische und rechtliche Fragen, da die meisten KI-Musikwerke von Musikverlegern sofort als Verletzung geistigen Eigentums gemeldet wurden.

Meta gab ausdrücklich an, dass das Standardmodell nur auf der Grundlage firmeneigener Musik und deren lizenzierter Musik erstellt wurde. Konkret nutzten sie 20.000 Stunden Audio und 400.000 Aufnahmen sowie Textbeschreibungen und Metadaten, alles unter dem Dach der Meta Music Initiative Sound Collection, der Plattformen Shutterstock und Pond5. Außerdem haben sie vor der Veröffentlichung sämtliche Gesangsstimmen entfernt, um eine Nachahmung der Stimmen der Ersteller zu verhindern.

Das zweite Modell, AudioGen, widmet sich der Erzeugung von Umgebungsgeräuschen und Soundeffekten. AudioGen ist ein diffusionsbasiertes Modell, wie die meisten modernen Bildgeneratoren (DALL-E 2, Stable Diffusion...). Bei der Diffusion lernt das Modell, anfängliche Daten, die vollständig aus Rauschen bestehen – etwa Audio oder Bilder –, schrittweise zu entrauschen und sie Schritt für Schritt näher an die Zieleingabe heranzuführen.

Zusätzlich zu den Effekten wurde AudioGen auch zur Erzeugung von Sprache entwickelt, was laut Meta von manchen dazu missbraucht werden könnte, Stimmen zu fälschen. Trotz der Bedenken haben sie zumindest vorerst keine spezifischen Einschränkungen für die verschiedenen Verwendungsmöglichkeiten von AudioCraft festgelegt.

Das dritte Modell, EnCodec, ist eine Verbesserung gegenüber Metas Vorgängermodell, um Musik mit weniger Artefakten zu erstellen. Meta behauptet, Audiosequenzen effizienter zu modellieren und unterschiedliche Informationsebenen zu erfassen, wenn Daten-Audiowellenformen trainiert werden, um die Erstellung neuer Audiodaten zu unterstützen.

Meta stellte sich AudioCraft als ein Werkzeug für Musiker und Schöpfer vor, mit dem sie neue Kompositionen erstellen können, ohne physisch Instrumente spielen zu müssen. Sie richteten sich auch an Entwickler mit einem begrenzteren Budget, die mit AudioCraft unterschiedliche Sounds für virtuelle Welten erstellen könnten, und Instagram-/TikTok-Ersteller könnten beispielsweise die am besten geeigneten Sounds für ihre Beiträge erstellen.

Zumindest vorerst erlaubt die Lizenz von AudioCraft keine kommerzielle Nutzung.

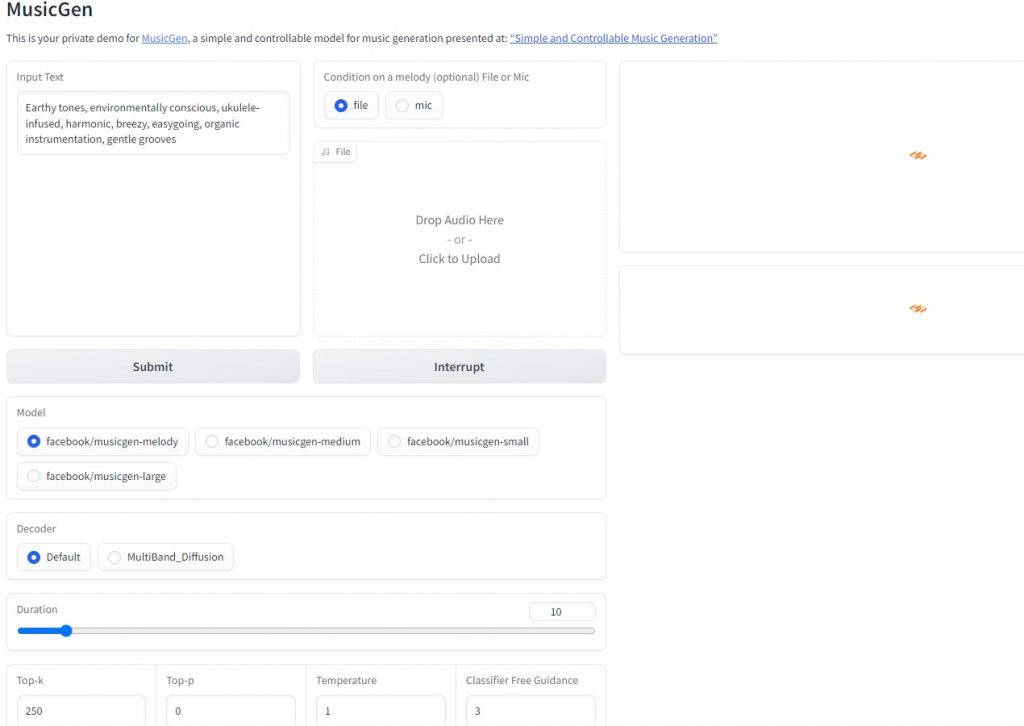

Wie installiere und teste ich das AudioCraft AI-Tool?

Der Code befindet sich auf GitHub, und es stehen Ihnen mehrere Installationsmöglichkeiten zur Verfügung. Sie können das Programm verwenden. Pinocchio (https://pinokio.computer) installiert das KI-Musiktool mehr oder weniger automatisch. Wählen Sie das AudioGradio-Modul aus der Bibliothek aus, installieren Sie es (dauert nur wenige Minuten) und Sie erhalten anschließend eine lokale IP-Adresse, mit der Sie AudioCraft testen können.

Andere Methoden erfordern die Vorinstallation von Python, Pip, Anaconda, minicondo oder ähnlichen Programmen. Eine gute und leicht verständliche Anleitung ist auf GitHub (https://bit.ly/GHglasba), gepostet von mberman84, gilt für das Miniconda-Programm. Das Endergebnis ist dasselbe: Sie erhalten eine IP-Adresse, die Sie in Ihren Browser eingeben und mit dem Experimentieren beginnen können.